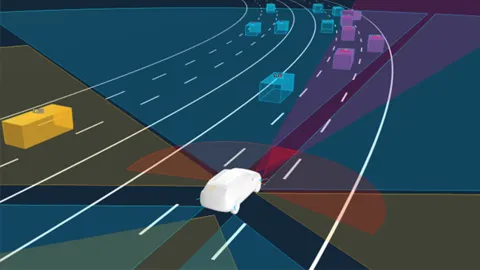

Um komplexe Umgebungen zu verstehen, benötigen automatisierte Systeme mehr als nur rohe Sensordaten – sie brauchen einen Kontext. Die High-Level-Sensorfusion führt bereits interpretierte Eingaben – wie erkannte Objekte – von mehreren Sensoren zu einer zusammenhängenden Ansicht zusammen. Das macht sie schneller, effizienter und einfacher zu skalieren. Darüber hinaus wird die Systemzuverlässigkeit durch Redundanz gestärkt, die Integration verschiedener Sensortypen vereinfacht und die modulare Entwicklung für verschiedene Anwendungen unterstützt.

Intelligentere Entwicklung, schnellere Ergebnisse

Durch die unabhängige Verarbeitung der einzelnen Sensoren können Entwickler bewährte Algorithmen wiederverwenden, das Debugging vereinfachen und das Prototyping beschleunigen. Es müssen keine Rohdatenströme synchronisiert werden, was die Komplexität und die Kosten senkt. Mit Tools wie dem AVL Scenario Simulator™ können Fusionsstrategien sogar virtuell getestet werden, wodurch eine teure physische Validierung überflüssig wird.

Typische Anwendungen von High-Level Fusion

Von ADAS und autonomem Fahren bis hin zu Logistik und Robotik – High-Level Fusion ist der Schlüssel zu einer zuverlässigen Echtzeit-Wahrnehmung in dynamischen Umgebungen. Sie unterstützt eine schnelle Entscheidungsfindung, bei der Anpassungsfähigkeit von entscheidender Bedeutung ist, insbesondere in städtischen Umgebungen oder komplexen Einsatzgebieten.

Dieses Webinar bildet den Auftakt zu einer dreiteiligen Reihe. Bleiben Sie dran für die kommenden Webinare, in denen wir weiter erörtern, wie man die Komplexität und die Sicherheitsherausforderungen bei der Entwicklung von ADAS/AD-Systemen bewältigen kann.